Jakie regulacje prawne powinny obejmować algorytmy rekrutacyjne?

Wzrost popularności algorytmów rekrutacyjnych budzi wiele pytań. Z jednej strony obiecują one efektywność i obiektywność, z drugiej – rodzą obawy dotyczące dyskryminacji i braku transparentności. Czy rzeczywiście algorytmy mogą zrewolucjonizować rynek pracy, eliminując subiektywne oceny i uprzedzenia? A może, nieopatrznie wdrożone, utrwalą istniejące nierówności, zagrażając prawom kandydatów? To pytania, na które musimy znaleźć odpowiedzi, zanim sztuczna inteligencja na dobre zadomowi się w procesach HR.

Już teraz widzimy, jak algorytmy wpływają na selekcję CV, analizę języka ciała podczas wideorozmów, a nawet na ocenę kompetencji na podstawie danych z mediów społecznościowych. Problem polega na tym, że mechanizmy działania tych systemów często pozostają ukryte, co utrudnia ocenę, czy nie faworyzują one określonych grup kosztem innych. Transparentność, a raczej jej brak, jest tutaj kluczowym problemem. Co więcej, algorytmy uczą się na danych historycznych, które same w sobie mogą być obarczone uprzedzeniami. Jeśli w przeszłości na dane stanowisko zatrudniano głównie mężczyzn, algorytm może zacząć automatycznie preferować męskich kandydatów, powielając tym samym dyskryminacyjne wzorce. I nagle obietnica obiektywności zamienia się w perpetuum mobile nierówności.

Odpowiedzią na te wyzwania powinny być jasne i precyzyjne regulacje prawne, które zapewnią, że algorytmy rekrutacyjne będą wykorzystywane w sposób etyczny i sprawiedliwy. Nie chodzi o całkowity zakaz ich stosowania – potencjał AI w usprawnieniu procesów rekrutacyjnych jest ogromny. Chodzi o stworzenie ram, które zminimalizują ryzyko dyskryminacji i zapewnią kandydatom realną możliwość odwołania się od decyzji podjętych na podstawie analizy algorytmicznej. To wymaga interdyscyplinarnego podejścia, łączącego wiedzę prawników, etyków, specjalistów od sztucznej inteligencji i ekspertów z zakresu HR.

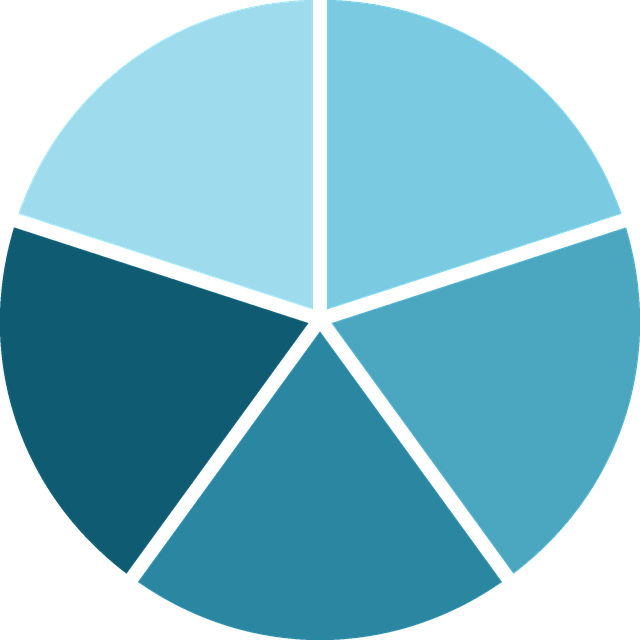

Obszary regulacji prawnych algorytmów rekrutacyjnych

Kluczowym elementem ram prawnych regulujących algorytmy rekrutacyjne powinna być definicja algorytmu rekrutacyjnego. Brzmi banalnie, ale w praktyce jest to istotne rozróżnienie. Musimy jasno określić, jakie systemy podlegają regulacjom, a jakie nie. Czy dotyczy to tylko tych algorytmów, które automatycznie odrzucają kandydatów, czy również tych, które wspierają rekrutera w procesie selekcji? Definicja powinna być szeroka, ale jednocześnie precyzyjna, aby uniknąć luk prawnych.

Kolejnym, niezwykle ważnym obszarem jest transparentność. Kandydat powinien mieć prawo do informacji o tym, czy w procesie rekrutacji użyto algorytmu, jakie dane były analizowane i w jaki sposób podejmowano decyzje. Oczywiście, nie chodzi o ujawnianie tajemnic przedsiębiorstwa, ale o zapewnienie minimalnego poziomu zrozumienia procesu. Firmy powinny być zobowiązane do informowania o logice działania algorytmu, o jego mocnych i słabych stronach, a także o potencjalnych źródłach błędów. Dodatkowo, kandydat powinien mieć prawo do zakwestionowania decyzji podjętej przez algorytm i do uzyskania wyjaśnień od rekrutera.

Równie istotne jest zagwarantowanie niedyskryminacji. Regulacje powinny zakazywać stosowania algorytmów, które pośrednio lub bezpośrednio dyskryminują kandydatów ze względu na płeć, rasę, pochodzenie etniczne, religię, orientację seksualną, niepełnosprawność lub inne prawnie chronione cechy. Firmy powinny być zobowiązane do przeprowadzania regularnych audytów algorytmów pod kątem występowania biasów i do podejmowania działań naprawczych, jeśli takie zostaną wykryte. Warto rozważyć wprowadzenie obowiązku testowania algorytmów na reprezentatywnych grupach kandydatów przed ich wdrożeniem w procesie rekrutacji. To pozwoli na wczesne wykrycie potencjalnych problemów i uniknięcie szkód.

Nie można zapominać o kwestiach związanych z ochroną danych osobowych. Algorytmy rekrutacyjne często przetwarzają wrażliwe dane, takie jak informacje o zdrowiu, przekonaniach politycznych czy przynależności związkowej. Regulacje powinny jasno określać, jakie dane mogą być przetwarzane, w jaki sposób są one chronione i jak długo mogą być przechowywane. Kandydat powinien mieć prawo do dostępu do swoich danych, do ich poprawiania i do ich usunięcia. Należy również wprowadzić mechanizmy kontroli nad tym, jak dane są wykorzystywane przez algorytm, aby uniknąć ich nadużywania.

Warto również rozważyć wprowadzenie certyfikacji dla algorytmów rekrutacyjnych. Firmy, które spełniają określone standardy w zakresie transparentności, niedyskryminacji i ochrony danych osobowych, mogłyby uzyskać certyfikat potwierdzający, że ich algorytmy są zgodne z prawem i etyczne. Taki certyfikat mógłby być dla kandydatów sygnałem, że dany proces rekrutacji jest prowadzony w sposób uczciwy i rzetelny. Dodatkowo, certyfikacja mogłaby być dobrowolna, co dałoby firmom możliwość wyróżnienia się na rynku i budowania zaufania wśród kandydatów.

Oczywiście, wprowadzenie skutecznych regulacji prawnych to dopiero początek. Równie ważne jest ich egzekwowanie. Konieczne jest powołanie niezależnego organu, który będzie monitorował stosowanie algorytmów rekrutacyjnych, przeprowadzał kontrole i nakładał sankcje w przypadku naruszeń. Organ ten powinien być wyposażony w odpowiednie kompetencje i zasoby, aby mógł skutecznie wykonywać swoje zadania. Ważne jest również, aby kandydaci mieli możliwość zgłaszania skarg na nieuczciwe praktyki rekrutacyjne i uzyskiwania odszkodowań w przypadku dyskryminacji.

Potrzebne są też edukacja i podnoszenie świadomości. Rekruterzy, menedżerowie i sami kandydaci powinni być świadomi potencjalnych zagrożeń związanych z używaniem algorytmów rekrutacyjnych. Firmy powinny inwestować w szkolenia dla swoich pracowników, aby nauczyć ich, jak prawidłowo korzystać z tych narzędzi i jak unikać dyskryminacji. Kandydaci powinni być informowani o swoich prawach i o tym, jak mogą się bronić przed nieuczciwymi praktykami rekrutacyjnymi. Tylko w ten sposób możemy zapewnić, że algorytmy rekrutacyjne będą wykorzystywane w sposób odpowiedzialny i etyczny.

Regulowanie algorytmów rekrutacyjnych to niełatwe zadanie, ale jest to zadanie konieczne. Stawką jest sprawiedliwość na rynku pracy i ochrona praw kandydatów. Nie możemy dopuścić do tego, aby sztuczna inteligencja utrwalała istniejące nierówności i dyskryminowała osoby poszukujące zatrudnienia. Musimy stworzyć ramy prawne, które zapewnią, że algorytmy rekrutacyjne będą wykorzystywane w sposób etyczny i transparentny, a kandydaci będą mieli realną możliwość odwołania się od decyzji podjętych na ich podstawie. To wymaga zaangażowania wszystkich zainteresowanych stron: legislatorów, firm, ekspertów i samych kandydatów. Tylko wspólnymi siłami możemy zbudować rynek pracy, w którym szanse na sukces będą równe dla wszystkich.